中企动力邮箱/上海短视频seo优化网站

内容目录:

感知机简介

感知机,模仿神经元,是神经网络中的基本单元。

它有多个输入,一个输出。

输入后,每个输入Xi乘以相应权重Wi相加,其总和再通过与阈值B相减,得到一个大于等于0或小于0的值,若大于0,输出1,否则输出-1。

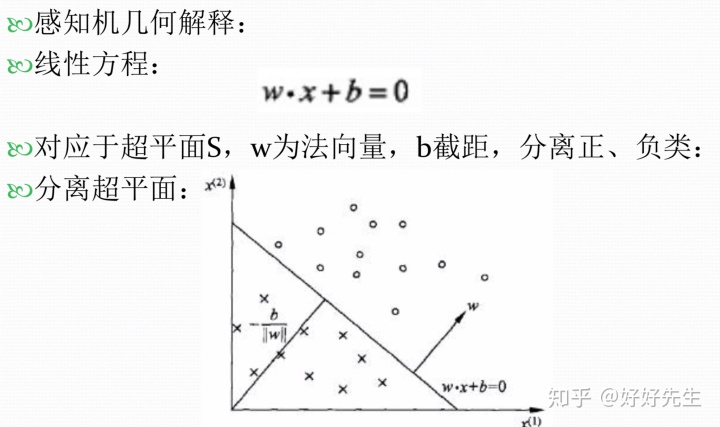

现在如果感知机被训练“成熟”,能正确输出“+1”、“-1”,判断“是”、“非”。即,将所有样本点正确分类。那么想象它的权重向量W和偏移B,构成了一个超平面。这个超平面把这个世界一分为二,若一边“是”的样本,一边“非”的样本,它本身,就是是非的准则

如果用绘制图像来阐述,那就是,如果“是”判断成了“非”,超平面首先朝“是”的反方向平移,相当于降低阈值。这样造成我们判断的结果整体倾向于“是”。

接着,我们假设此时空间样本点为X0,那么其正确结果应为“是”,即“+1”,我们把空间点(X0,1)构成的向量称作V,是我们期待的正确方向;现在我们的分类超平面Y=WX+B,试图朝着方向V旋转,以做调整。

这种调整如何得来,为什么它是正确的?

因为如果我们把X0样本点进行了错误归类,产生错误结果-1。那么这次错误的损失可以量化为-(WX0+B)。当X0已知,我们想针对(W,B)寻求一种变化,这种变化的结果使以上损失接近最小值,那就是沿着的梯度方向走,也就是朝变化最快的方向调整。

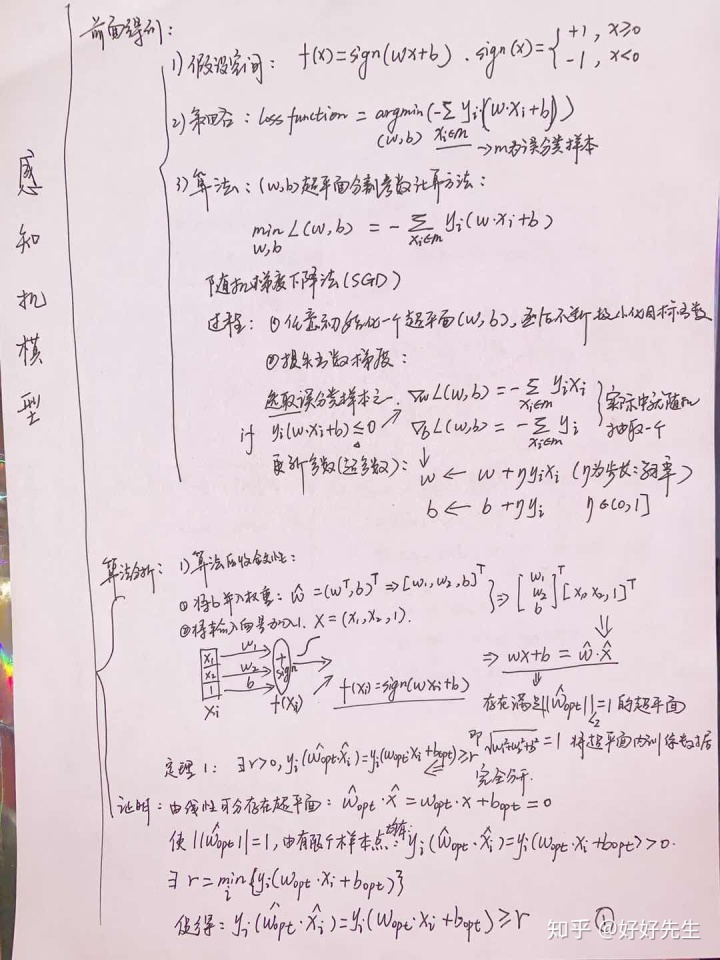

- 感知机模型

- 感知机学习策略

- 感知机学习方法

- 感知机模型收敛性分析

- 感知机模型对偶形式

- 感知机的衍生

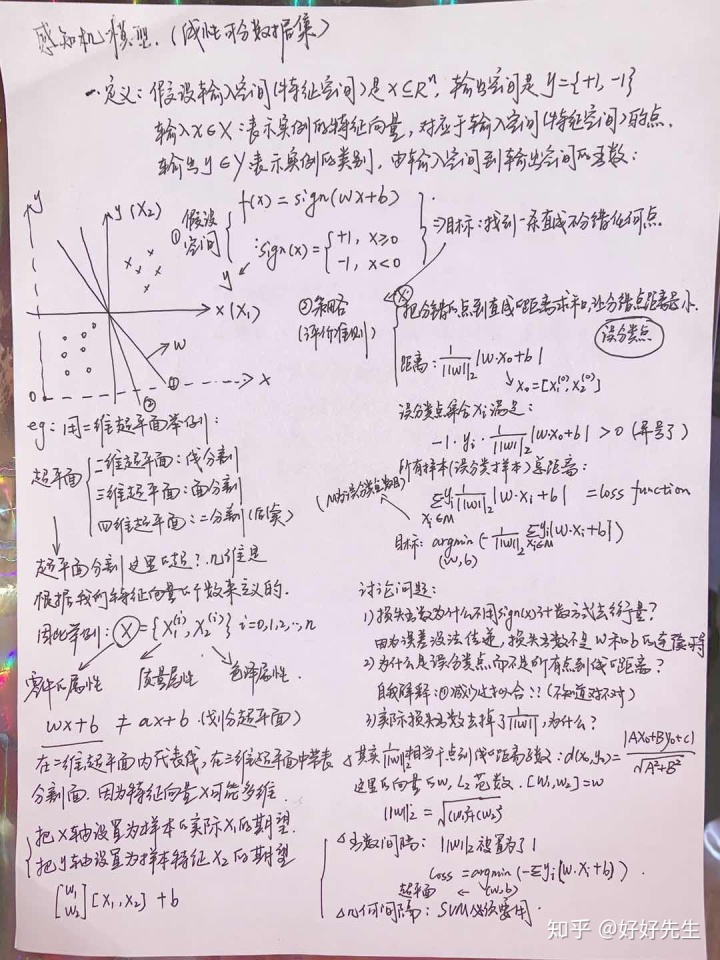

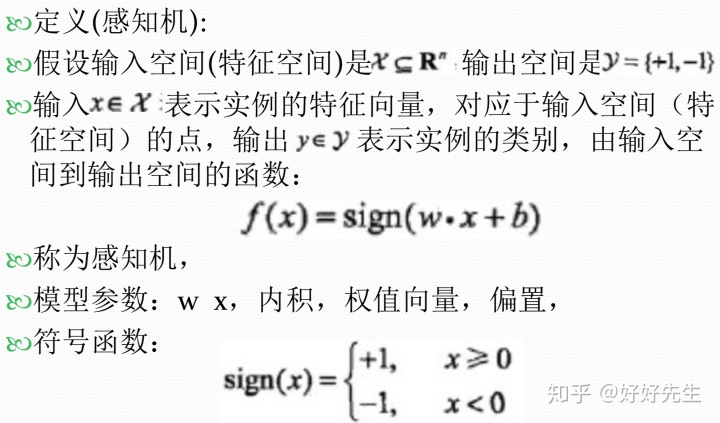

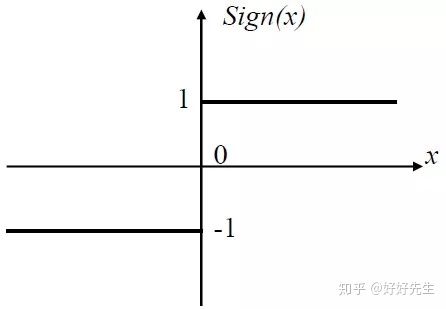

1. 感知机模型

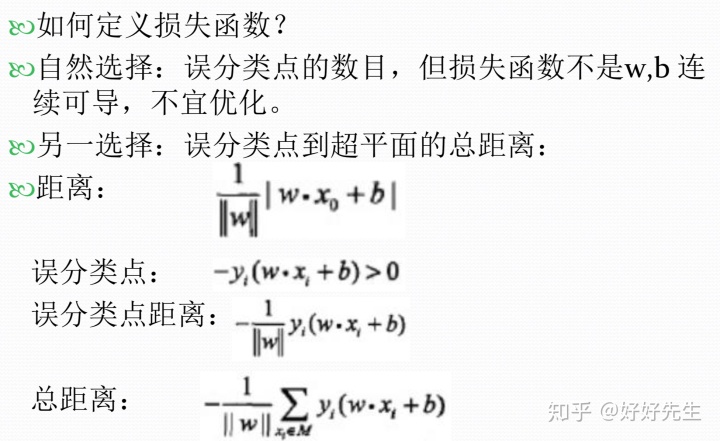

2. 感知机学习策略

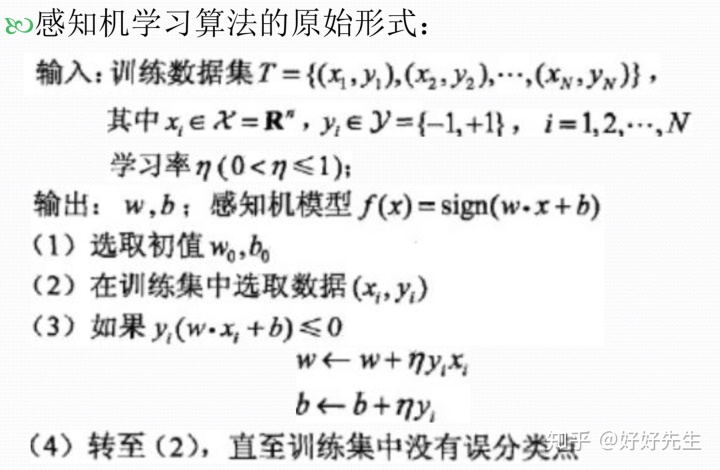

for k in range(iter):#对于每一个样本进行梯度下降#李航书中在2.3.1开头部分使用的梯度下降,是全部样本都算一遍以后,统一#进行一次梯度下降#在2.3.1的后半部分可以看到,此时用的是随机梯度下降,即计算一个样本就针对该样本进行一次梯度下降。#两者的差异各有千秋,但较为常用的是随机梯度下降。for i in range(m):#获取当前样本的向量xi = dataMat[i]#获取当前样本所对应的标签yi = labelMat[i]#判断是否是误分类样本#误分类样本特诊为: -yi(w*xi+b)>=0,详细可参考书中2.2.2小节#在书的公式中写的是>0,实际上如果=0,说明改点在超平面上,也是不正确的if -1 * yi * (w * xi.T + b) >= 0:#对于误分类样本,进行梯度下降,更新w和bw = w + h * yi * xib = b + h * yi3. 感知机学习算法

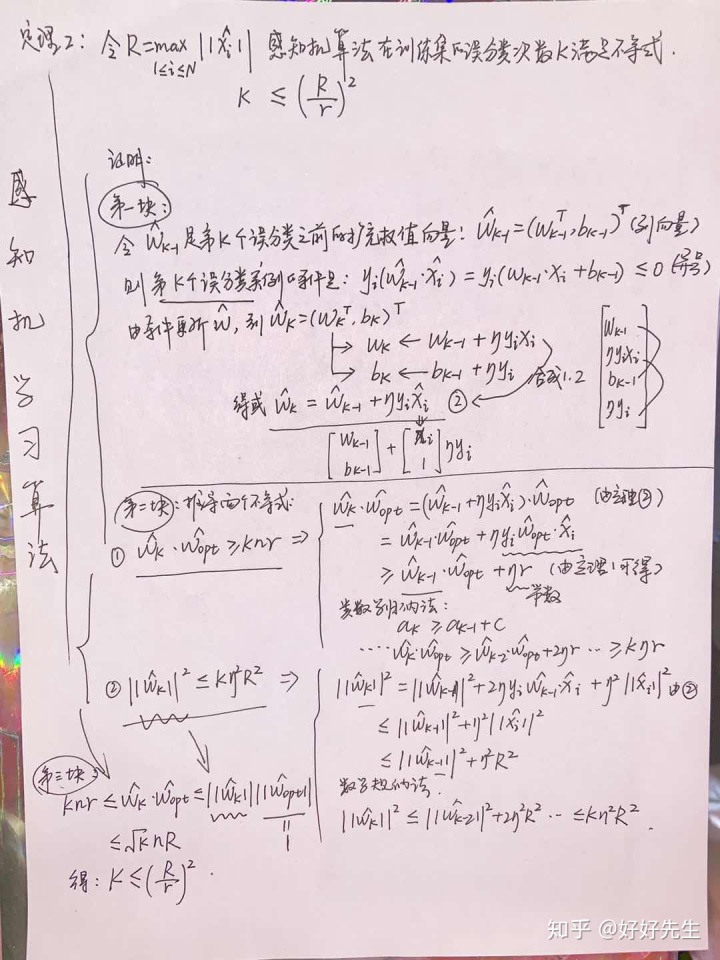

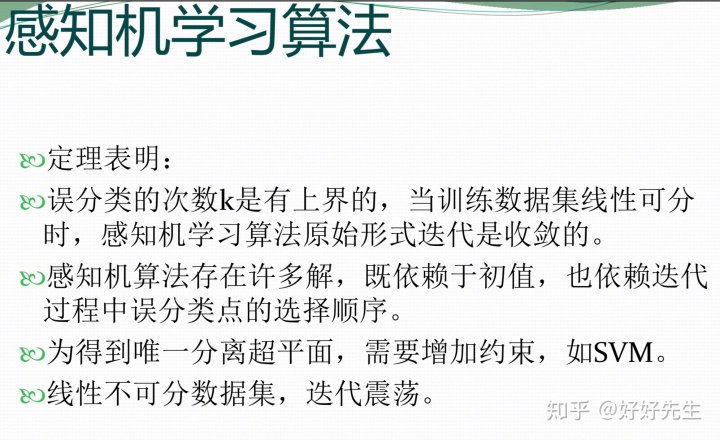

4. 感知学习算法的收敛性

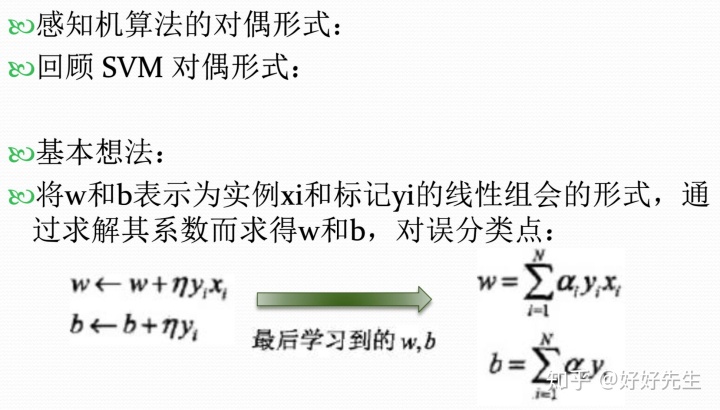

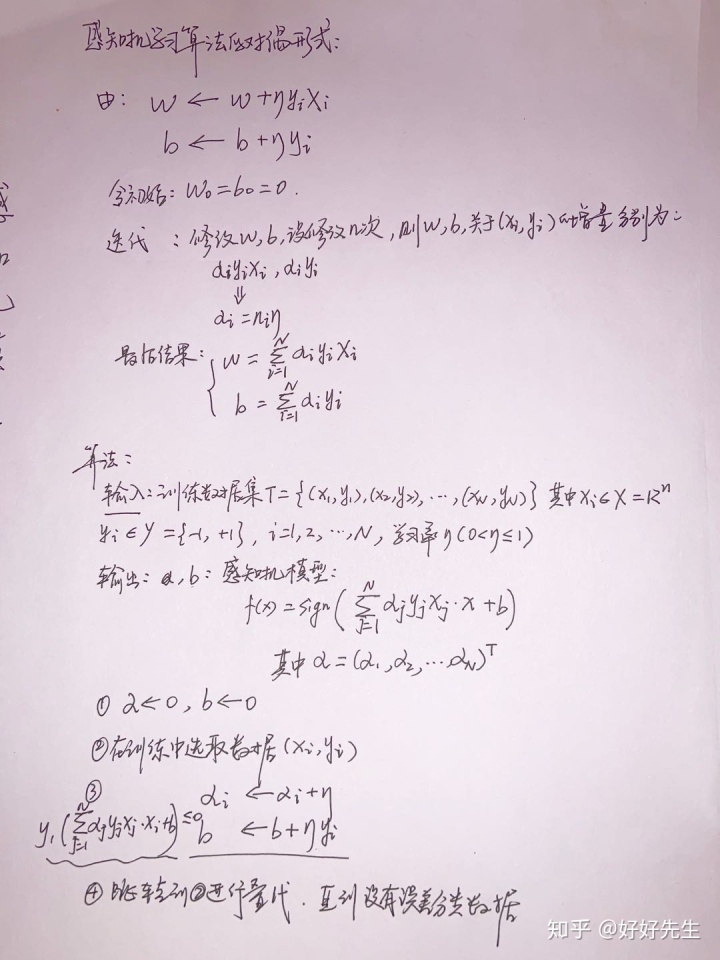

5.感知学习算法的对偶形式

6. 感知机的衍生

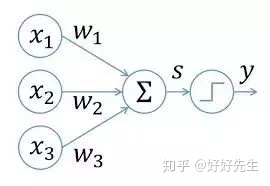

感知机作为神经网络和支持向量机的理论基础,相信任何有机器学习基础的同学都清楚其模型细节。简单而言,感知机就是一个旨在建立一个线性超平面对线性可分的数据集进行分类的线性模型。其基本结构如下所示:

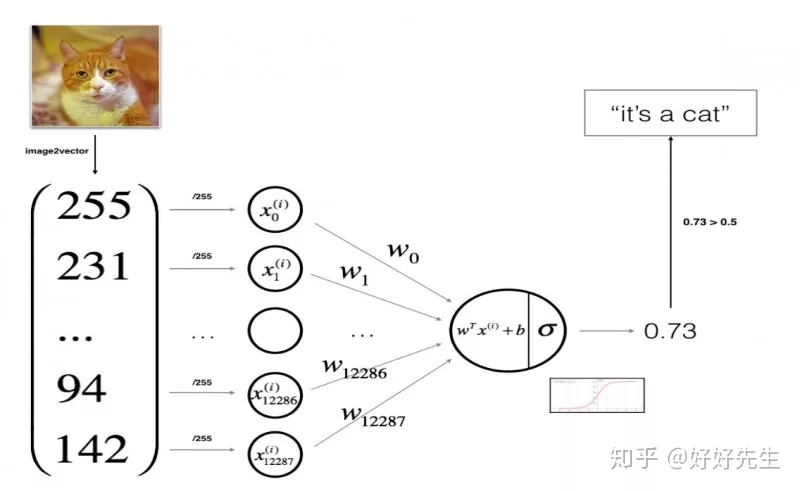

上图从左到右为感知机模型的计算执行方向,模型接受了X1、X2、X3三个输入,将输入与权值参数W进行加权求和并经过 sigmoid 函数进行激活,将激活结果作为 y 进行输出。这便是感知机执行前向计算的基本过程。这样就行了吗?当然不行。按照李航老师的统计学习三要素来打分,刚刚我们只解释了模型,对策略和算法并未解释。当我们执行完前向计算得到输出之后,模型需要根据你的输出和实际的输出按照损失函数计算当前损失,计算损失函数关于权值和偏置的梯度,然后根据梯度下降法更新权值和偏置。经过不断的迭代调整权值和偏置使得损失最小,这便是完整的单层感知机的训练过程。

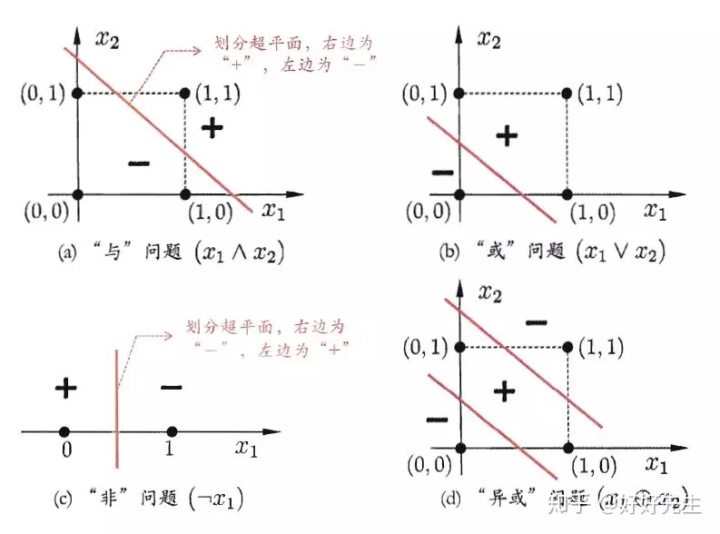

上述的单层感知机包含两层神经元,即输入与输出神经元,可以非常容易的实现逻辑与、或和非等线性可分情形,但终归而言,这样的一层感知机的学习能力是非常有限的,对于像异或这样的非线性情形,单层感知机就搞不定了。其学习过程会呈现一定程度的振荡,权值参数 w 难以稳定下来,最终不能求得合适的解。

对于非线性可分的情况,在感知机基础上一般有了两个解决方向,一个就是著名的支持向量机模型,旨在通过核函数映射来处理非线性的情况,这里我们不多谈,读者朋友们可以去回顾复习机器学习中有关的内容,而另一种就是神经网络模型。这里的神经网络模型也叫多层感知机(MLP: Muti-Layer Perception),与单层的感知机在结构上的区别主要在于 MLP 多了若干隐藏层,这使得神经网络对非线性的情况拟合能力大大增强。

代码参考:

https://github.com/zjgulai/lihang_book_algorithmgithub.com更多详情:

http://mp.weixin.qq.com/s?__biz=MzI0ODM4MDQ2Nw==&mid=100002381&idx=1&sn=448006a3a2282ce4a2df36e9887e555a&chksm=69a0e7115ed76e073263b6d51c6a4afe569952fc90dffb4a1188f8d8764d21792dace7339363#rdmp.weixin.qq.com